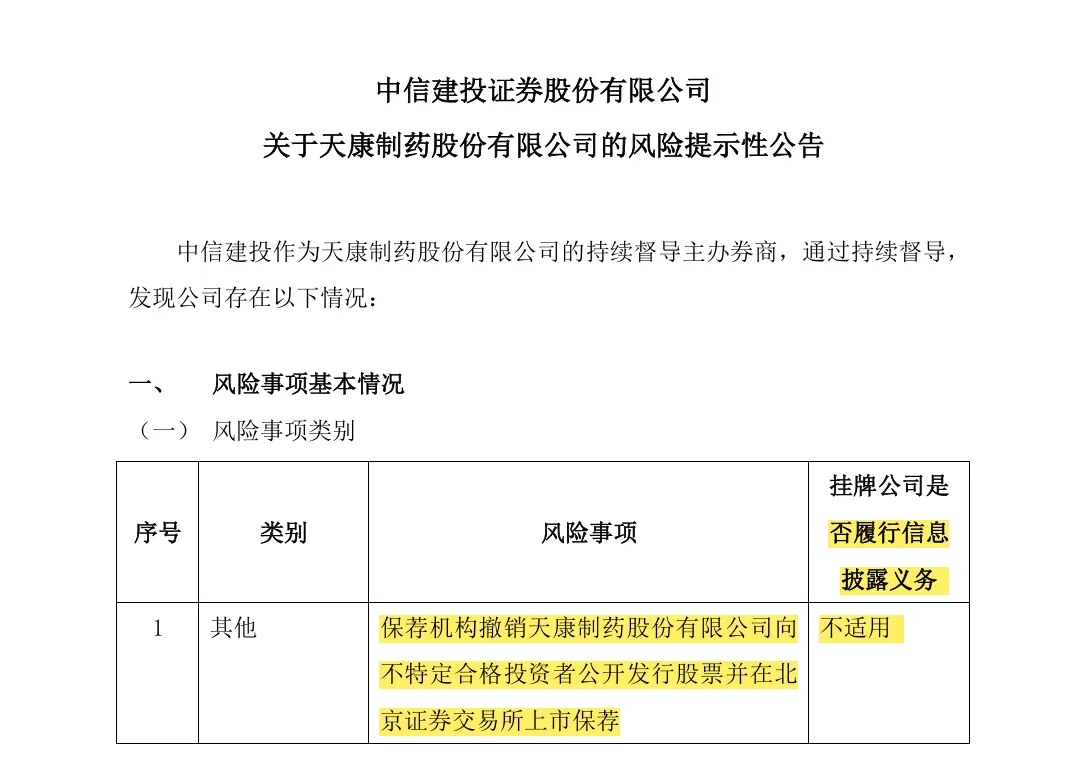

近期,一份Agentic AI驱动服务器CPU需求远期达到2亿颗的券商研报观点,在产业和投资圈广泛传播。报告从Agent低延迟特性、复杂逻辑编排本质出发,论证Agent不同于传统Chatbot,不再依赖擅长简单并行计算的GPU,高度依赖擅长复杂逻辑调度的高性能CPU;再通过10亿级用户、人均日20次任务、多层子Agent拆解等模型,线性推导出远期海量CPU核心需求,最终得出2亿颗服务器CPU的成长空间。

这套逻辑框架看起来层层递进、数据闭环,但只要站在算力工程实际运行角度审视,就能发现其测算存在一个非常基础的底层硬伤:把全天累计任务总次数,直接等同于瞬时常驻独占算力,完全忽略了服务器CPU最核心的分时复用、任务瞬时执行、潮汐波峰波谷的产业现实。

研报的测算逻辑十分直白:10亿Agent用户、单日人均20次任务、单次拆分5个子Agent并行,折算为单日千亿级执行次数;再按单次任务占用固定CPU核心数量,直接累加得到总核心需求,最后换算成对应服务器CPU总量。这种算法默认所有任务在同一时刻集中爆发,每一颗CPU核心一旦被调用就全程独占、永不释放。

但真实算力运行完全不是这个逻辑。Agent推理属于短耗时任务,单次思考编排与工具调用仅毫秒到秒级,任务结束后CPU线程立刻释放,通过时间切片和进程调度,一颗物理核心一天可以复用承接成千上万次任务。决定服务器采购量的永远是峰值并发QPS,而非全天累计调用总量。海量日累计请求分散在24小时时间轴上,平均瞬时算力需求会大幅稀释,远达不到研报平铺直算的量级。

很多人会疑惑,头部专业券商研报,为何会出现这种看似低级的测算漏洞?本质并不是分析师不懂算力调度常识,而是卖方研报的本质是叙事报告,而非工程算力规划报告。

券商TMT研报的核心使命,是塑造产业主线、打开估值想象、给机构提供可以抱团的看多逻辑,而不是做严谨的数据中心基建算力测算。想要讲好“Agent重构通用计算、CPU迎来超级大周期”的故事,就必须给出足够震撼、具备传播力的远期空间数字。一旦引入算力利用率、并发系数、分时复用这些现实参数,2亿颗的宏大天花板会瞬间缩水,产业情绪和估值想象力都会大打折扣。

所以这份测算属于典型的先定看多结论,再倒推匹配数据。刻意选用最粗放、最乐观的线性平铺模型,放弃工程严谨性,优先保证产业故事的冲击力。再叠加引用海外学术论文数据、外资CPU/GPU配比观点,为整套偏理想化的拍数,套上专业背书,更利于在机构圈层传播发酵。

同时,分析师擅长产业趋势、产业链格局和估值比较,并不深耕数据中心集群调度、算力资源建模这类工程细节,专业领域的错位,也容易在量化测算环节出现理想化偏差。市场参与者也大多心照不宣,大家看重的是「Agent重逻辑、CPU价值重估」的核心产业方向,并不会过度深究中间测算细节。

客观来说,Agent时代到来,复杂逻辑编排、长链路任务调度,确实会持续抬升高性能服务器CPU的长期景气度,CPU替代单纯GPU并行计算、通用计算价值回归是确定趋势。但2亿颗远期需求量级,只能当作情绪叙事的理论天花板,不能当作真实产业需求和落地业绩的判断依据。

看待这类研报,我们要分开两件事:一是认可Agent带动CPU产业逻辑反转的长期趋势,二是理性区分专业产业推演和营销式叙事拍数。理性剥离夸大的测算数字,坚守算力复用的基本常识,才能既抓住产业变革机会,又不被极致乐观的宏大叙事带偏判断。

研报速递

研报速递

发表评论

发表评论: