合规专业不打烊

关注小兵不迷航

有小兵陪伴 工作不慌张

·视频号·

·公众号·

·小程序·

券商AI智能体全场景应用法律提示

欲止

当前证券行业AI智能体已广泛覆盖财富管理、投行、风控等多条业务线,在企业微信、外部平台(coze等)、自建数字化平台等内外部渠道上线运营数量持续增加,同时OpenClaw等“主动执行式AI”成为金融投研领域前沿探索方向,人工智能相关行业监管要求与协会安全标准也在持续完善更新。为将风险防控意识嵌入AI智能体开发、上架、运营、迭代全生命周期,提前防范金融机构在AI智能体应用中的潜在法律合规风险,笔者结合中国软件行业协会《智能体行为安全要求》、广东省标准化协会《智能体任务执行安全要求》等行业标准,及《个人信息保护法》《生成式人工智能服务管理暂行办法》等法律法规,参考证券行业实践与前沿AI技术监管提示,现就证券行业AI智能体全场景应用出具本法律提示,旨在明确潜在风险点与实操规范,助力金融机构AI业务依法合规开展。

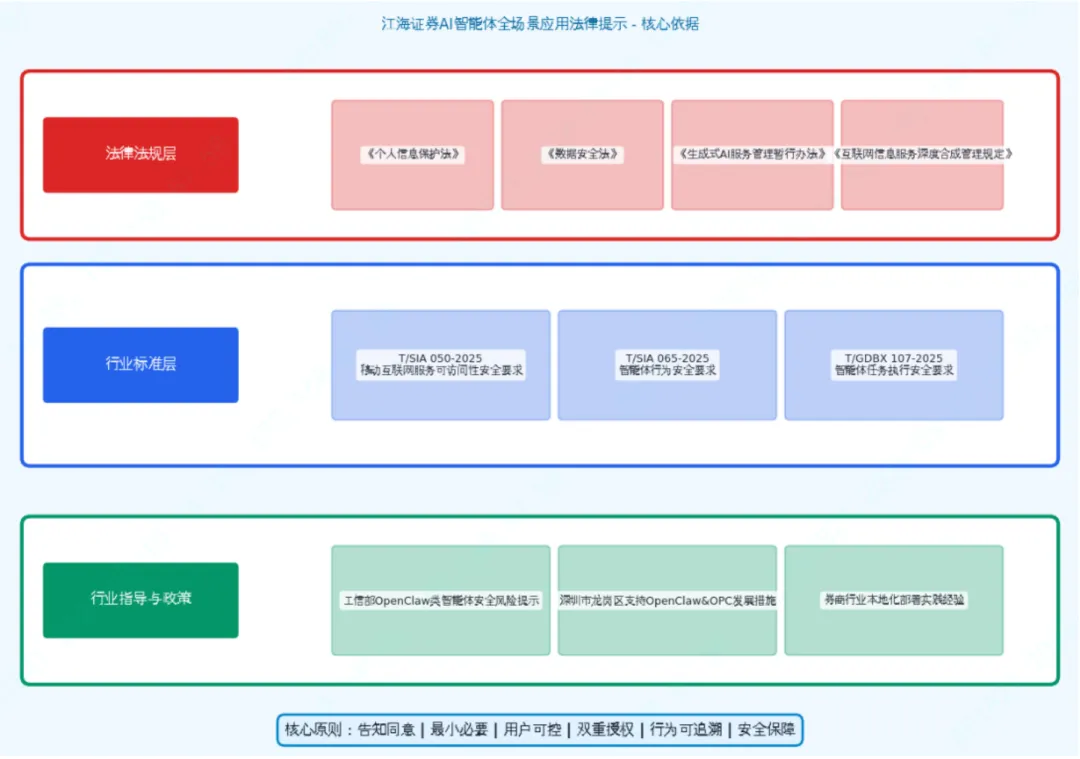

一、核心依据与行业监管动态提示

(一)核心适用规范

1.行业标准:中国软件行业协会《智能体行为安全要求》(T/SIA065-2025)、《移动互联网服务可访问性安全要求》(T/SIA050-2025),广东省标准化协会《智能体任务执行安全要求》(T/GDBX 107-2025),明确告知同意、最小必要、用户可控、双重授权、行为可追溯等核心原则;

2.法律法规:《个人信息保护法》《数据安全法》《生成式人工智能服务管理暂行办法》《互联网信息服务深度合成管理规定》,聚焦数据安全、个人信息保护、生成内容标识、算法备案等法定要求;

3.行业参考:工信部对OpenClaw类智能体的安全风险提示、《深圳市龙岗区支持OpenClaw&OPC发展的若干措施(征求意见稿)》,及头部券商在AI大模型本地化部署、前沿AI技术隔离测试的实践经验。

(二)近期监管与行业关注重点

1.外部公共平台AI应用需严格落实生成内容显式/隐式标识要求,未按要求标识将面临监管处罚,且具备舆论属性的AI应用需完成算法备案、安全评估等法定手续;

2.金融行业AI应用强调数据本地化处理原则,禁止核心金融数据、客户敏感信息泄露至第三方主体,大模型使用前需完成本地化部署与合规测试;

3.OpenClaw等主动执行式AI因具备操作本地操作系统的权限,被监管明确要求采取隔离部署、权限白名单、人工复核等管控措施,防范因指令诱导、越权操作导致的数据泄露与系统安全风险。

二、证券行业AI智能体应用中需重点关注的潜在法律风险点

结合证券行业AI智能体上线运营台账全场景梳理,对照行业标准与监管要求,针对外部公共平台上架、内部平台运营使用、前沿AI技术探索三大核心场景,梳理金融机构需重点关注的潜在风险点,具体如下:

(一)外部公共平台上架智能体需关注的潜在风险

针对面向客户提供服务的计算器、投教文案生成、行情分析等类AI智能体,需重点关注四类潜在法律合规风险,提前完善管控措施:

1.数据处理合规管控的潜在疏漏:若收集客户金融相关数据时,未完全落实脱敏加密、权限最小化管理要求,或未为客户提供便捷的权限撤回路径,可能存在违反个人信息保护相关规定的潜在风险;

2.生成内容标识与备案的合规衔接:生成式内容若未按要求规范添加显式标识,或文件元数据未嵌入隐式标识,以及具有舆论属性/社会动员能力的智能体未及时完成算法备案、安全评估,可能存在与监管要求衔接不到位的问题;

3.结果提示与责任界定的完善性:计算器、市场分析类智能体若未在服务界面显著位置设置清晰的风险提示,或未在用户协议中明确合理的责任界定条款,可能存在后续引发客户理解偏差的潜在风险;

4.知识产权保护的前置把控:智能体的名称、功能设计、算法模型等若未提前开展知识产权检索,可能存在与他人在先商标、软件著作权等知识产权产生冲突的潜在风险。

(二)内部平台运营智能体需关注的潜在风险

针对内部员工使用的合规问答助手、大模型相关应用、审计报告生成等类AI智能体,需重点关注三类潜在法律合规风险,强化日常运营管控:

1.大模型使用中的知识产权保护衔接:传播第三方大模型相关资料时,若未严格遵循注明出处、不擅自二次篡改的要求,或未获授权将机构标识与第三方大模型商标结合使用,可能存在知识产权合规衔接的潜在疏漏;

2.数据本地化与权限管理的把控:部分智能体若未完全实现数据本地化部署,或权限隔离、分级管控机制缺位,可能存在内部业务数据、客户信息访问与使用的潜在安全隐患;

3.行为可追溯与第三方协作的要求:若智能体未对指令接收、数据处理、任务执行全流程进行完整记录,或与第三方APP协作时未严格落实“双重授权”原则、未充分保障用户知情权,可能存在操作流程不合规的潜在问题。

(三)OpenClaw等前沿AI技术探索需关注的潜在风险

结合证券行业实践与工信部安全提示,金融机构若探索该类主动执行式AI在投研、数据分析等场景的应用,需提前关注三类特有潜在风险,做好前置防控:

1.系统权限管控的边界把控:该类AI具备操作本地操作系统的能力,若未提前设置严格的权限边界与全流程管控机制,可能存在权限使用超出预设范围的潜在风险;

2.数据隐私保护的隔离措施:若在技术测试阶段未落实严格的环境隔离要求,可能存在投研相关数据、金融机构内部敏感信息泄露的潜在安全隐患;

3.内部审批与风险处置的流程衔接:若未履行完整的需求评估、技术论证、跨部门合规审核流程,或未提前建立异常操作应急处置机制,可能存在流程合规性的潜在疏漏。

三、法律服务前置:证券行业AI智能体全场景实操要点提示

针对上述需重点关注的潜在风险,结合行业标准与金融行业法律法规要求,将合规管控措施前置至AI智能体应用各业务环节,明确分场景操作规范、核心合规要求、风险处置流程,供金融机构参考执行,提前防范潜在风险:

(一)外部公共平台智能体上架实操提示

1.数据处理合规要求:仅收集完成指定任务或面向客户提供特定服务所必需的信息,对客户金融相关数据采取脱敏、加密等安全保护措施;不得强制、频繁向客户索取系统权限,为客户提供清晰、便捷的权限撤回路径,严格落实“最小必要原则”;

2.内容标识与备案要求:生成式内容需在服务界面显著位置添加规范显式标识(如加黑加粗标红“本内容由AI生成,仅供参考,不构成任何投资建议”),支持下载/导出的文件需按要求在元数据中嵌入隐式标识;若智能体具有舆论属性/社会动员能力,需在正式上线前完成算法备案、安全评估,并在服务界面醒目标注备案编号;

3.责任限制与风险提示:面向客户的AI智能体需配套制定完善的用户协议及隐私政策,在文本中明确合理的责任界定与免责条款,在使用界面设置首次使用风险提示弹窗,需客户确认后方可使用,确保客户充分知晓使用风险;

4.上架申请审核前置:正式上线前需落实金融机构内部管理制度要求,提交合规申报材料,明确数据处理方式、内容标识方案、权限申请范围,经内部合规、技术等部门联合审核通过后方可上架。

(二)内部平台智能体运营实操提示

1.知识产权保护要点:禁止擅自二次篡改第三方大模型相关资料,传播时需清晰注明资料出处;未获第三方正式授权,不得将机构logo、标识与第三方商标混淆使用,避免知识产权侵权风险;

2.数据本地化与权限管理:内部使用的AI智能体需严格实现数据本地化部署,禁止将核心业务数据、客户敏感信息提供给任何第三方主体;建立完善的分级访问权限控制机制,根据员工岗位、工作职责划定数据访问与操作权限;

3.行为可追溯与协作管控:智能体需对指令接收、数据处理、任务执行等全流程操作信息进行完整记录,数据留存期限不少于3年,支持金融机构后台全流程回溯查看;与第三方APP协作的智能体,需严格落实“双重授权”原则,确保操作合规性;

4.内部使用风险自查:金融机构各业务部门需定期对本部门内部智能体使用情况开展合规自查,重点核查数据处理方式、系统权限使用、知识产权保护等方面的合规性,形成自查报告并留存备查。

(三)OpenClaw等前沿AI技术探索实操提示

遵循“隔离测试、权限严控、流程先行、人工复核”的核心原则,在合规框架内开展前沿AI技术的探索与测试,具体要求:

1.部署环境要求:仅可在专用虚拟机或隔离的云测试环境中进行技术验证,禁止在日常办公电脑、生产业务系统、存储敏感数据的服务器中直接安装,与金融机构核心交易系统、风控系统实现物理隔离;

2.权限与操作管控:严格限制AI的操作系统权限,建立操作白名单机制,仅允许执行预设的投研辅助类任务(如公告信息抓取、市场数据整理),禁止访问客户敏感数据与金融机构核心业务系统;

3.内部流程审核:开展技术探索前,需完成内部需求评估、技术可行性论证、合规风险评估等流程,经合规风控、人工智能管理、信息技术等部门联合审核通过后方可开展测试;

4.人工复核与安全防护:AI生成的投研结论、市场数据分析结果仅可作为内部工作辅助参考,需经业务人员、投研人员人工复核后方可使用;落实漏洞扫描、实时监控等安全技术措施,建立异常操作应急处置机制,防范潜在的指令诱导与越权操作问题。

(四)证券行业AI智能体通用合规原则

金融机构开发、运营各类AI智能体,均需严格落实以下核心合规原则,强化全员法律风险防范意识:

1.告知同意原则:智能体启用前,需向用户明确告知功能范围、数据收集目的及处理方式,依法获取用户明示同意;任务执行过程中需获取新权限、收集新数据的,需重新向用户告知并获取同意;

2.最小必要原则:仅申请任务执行必需的系统权限,仅收集完成任务必需的数据信息,不得过度收集、超范围使用用户数据和系统权限;

3.用户可控原则:支持用户随时开启、关闭、终止智能体操作,第三方APP不得要求额外授权以妨碍用户的自主可控性;

4.安全保障原则:设置智能体行为安全红线,禁止代理用户执行涉及财产(含虚拟)、人身安全的操作(如账号注销、金融支付、资金转账等);

5.档案管理原则:金融机构各部门需留存AI智能体开发、上架、运营的全套合规资料(如审核文件、授权证明、自查报告、操作记录等),建档备查,资料保存期限不少于3年,《证券法》等法律法规及行业监管政策另有规定的,从其规定执行。

本法律提示基于现行法律法规、人工智能行业标准及证券行业业务实际出具,后续若相关规定发生变化或行业业务场景调整,将适时更新补充。

特别申明:

1、本微信公众号纯属玩票,只为交流,力求原创,如有不妥,敬请告知,我们立即删除。

2、合规小兵设立qq交流群,从qq群衍生出大经纪、大资管、大投行、大投资、金融法务、反洗钱、公募基金(前述群采取严格管理并收取一定金额的群费),以及ABS、衍生品、信用业务、证券咨询投顾、托管业务、异常交易、适当性、金融科技、信息隔离墙、个人信息保护、廉洁从业、声誉风险、操作风险、信用风险、全面风险管理、期货等十多个内控专业微信群。想加入相应群的,请咨询贵司内控人员,熟知群规,通过他们邀请入群。

3、欢迎大家积极投稿 (邮箱156473549@qq.com) ,传播,但文责自负。

4、坚持原创,十分不易。未经授权不得转载,侵权必究。如果觉得本文还有点价值,欢迎在右下角点赞、在看,通过右上角转发 (俗称三连),在文章正下位置点击喜欢作者或钟意作者进行打赏。

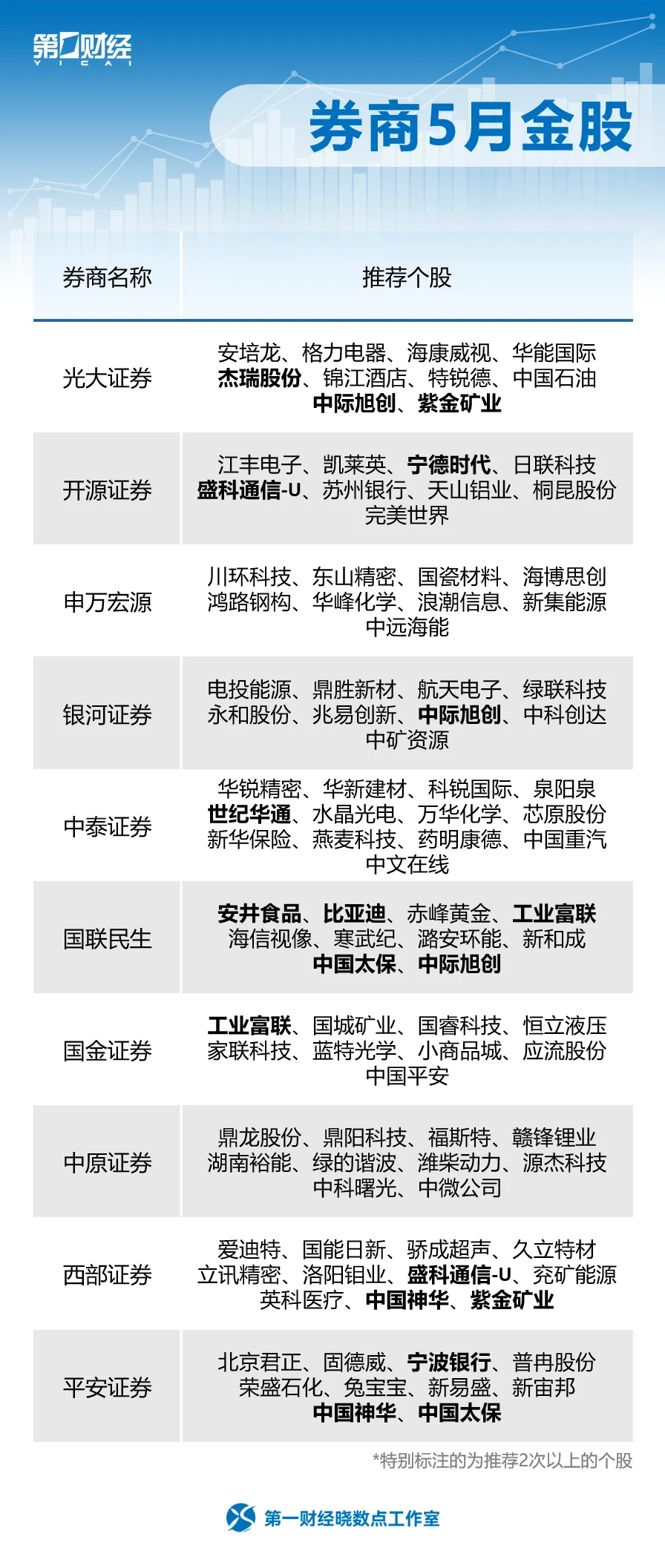

研报速递

研报速递

发表评论

发表评论: